なんて真面目っぽいタイトルで始めるけれど、ただの愚痴雑記。

日曜夕方だってのについ仕事用のメールを開いてしまったのが失敗の始まり。

知らないポスドクから届いていたメールを要約すると……

「論文投稿したんやでー」

ふむふむ、よかったな。 ……ところで、君誰?

「メジャーレヴィジョンやでー」

そうか。ちょっと大変だけど、メジャーは結構通るもんだしまあ頑張れ。

「お前のプログラム使ってこの論文書いてたんやでー」

へえ、そうなんだね。まあ何人かに配ったプログラムだからそういうこともあるかもね。

「それでな、とりあえずお前のこと著者に混ぜたろうと思うんやー」

……ん? なんで? もうメジャーレビジョンしてるんでしょ?

「レビューアの突っ込みに儂らだけじゃ応えられないんやでー」

あー……いや、プログラム使ってくれるのはありがたいのだけどさ、内容わからないで使ってるなら先にコンタクトとってもらいたかったなあ……

「ほんじゃー著者に名前入るわけだし頑張ってなー」

へ、へえ……やだ。

……ってな感じのメールを頂いたので、丁重に共著者に入ることはお断りしたのだ。まあ、しょうがないからレビジョンの手伝いは少しするけれどさ。たぶんちょっとやり取りしたら通る感じの論文ではありそうだったし。

まあ、それで本題に戻るわけなんだけど、みなさんはどうやって論文の共著者を決めてますかねえ?

原則的なルールに則っていくと、論文に対して重大な貢献をしてる人だけをいれるってことになるんだよね。この辺シビアなグループとそうじゃないグループは結構あって、シビアな人たちはホントに……

- 論文をデザインした人(主にシニア)

- 主要な実験をした人(主にファースト)

- その人抜きじゃどうにもならない材料、実験や解析を付け加えた人

このくらいのコントリビューションが無いと著者に入れないっていうグループもある。

うちのグループは化学工学で材料科学って感じの場所なのでかなり緩め。

論文をいっぱい書くグループの方が、共著者が増えていく印象があるかな。ただの印象だけど。

そんなわけで、うちの場合なんかだと……

- 予算とってきた人(+ちょろっと編集仕事)

- 細部の実験に手を貸してくれた人(+ちょろっと編集仕事)

- 解析方法のプログラムの提供(+ちょろっと編集仕事}

- あと協力した他所の学生のボス(+ちょろっと編集)。これが一番意見が分かれるところだけど、実際問題として共同プロジェクト的な形にしてボスもいれるってのはよくある話。揉めることもある話だから、PIの人には学生やらポスドク任せにしないで欲しい。うちの今のボスもこの辺結構いい加減で疲れることが多かった。

なんてあたりも共著者に入っていったりしている。とはいえ、このあたりも編集仕事をどれかけ真面目にやってるかとか、仕事が一つ二つ三つと重なってけばまあ正当な著者とも言えるのだろうけどね。

私もなるべくならば実験をして解析をして、論文にしっかりと意見を言うってくらいのところまでは著者になるような場合はしている。

逆に言うとちょろっと実験しただけで後は何もせず、しれっと名前を論文に乗せる人もいっぱいいるわけなんだけどね。

前もちょっと愚痴雑記を書いたけれど、著者いっぱいの論文が増えてる現在、シニアかファースト以外の価値なんてあってないようなもの。

ほんとはシビアな著者選定にしといた方が皆幸せになるのかもしれないけど、実際分業制の進んでいる昨今ではそうも言ってられないってのも事実。

著者選定とその評価のあり方ってのは、偉い人達がしっかりとオーガナイズしてくれないと、若手とか学生が困っちゃいますよねーって話ですね。

今の大学とかだとこのあたりを教える講義とかあったりするのかしらね? 論文倫理学? 昔もあったのかな?

まあそれはいいのだけど……話をちょっと今日のメールのやつに戻すと、まあ私は論文で使う解析ソフトを他の目的で書いただけだし、彼らがそれを流用して私抜きで論文を仕上げられるのならば私が著者に入る必要は全くない。

プログラムの理解に怪しいところがあるんだったら先に連絡をしてほしかったけれど、それを教えたからって私が著者に入る必要はやはりない。

彼らのデータのとり方の指導をして、彼らのためにプログラムを書き換えて、論文を仕上げていくときにそれなりに使える意見を出した……このあたりが論文の著者に入るのに妥当なラインなのかなー。

まあ今回のメールにしても、別に著者に入れるなんて言わなくてよかったんだよね。彼らがこの論文を作り上げた段階で私を入れる必要がないと思っているわけで、それには100%同意だし。

論文の真ん中くらいに名前を載せることなんて大した意味はないんだからさ、こういうときに遠慮せずにアクノーレッジするからちょっと意見貸してなーって言える状況にあったほうが健全だよねー。

なんてことを綴りたくなった愚痴雑記でした。

関連記事

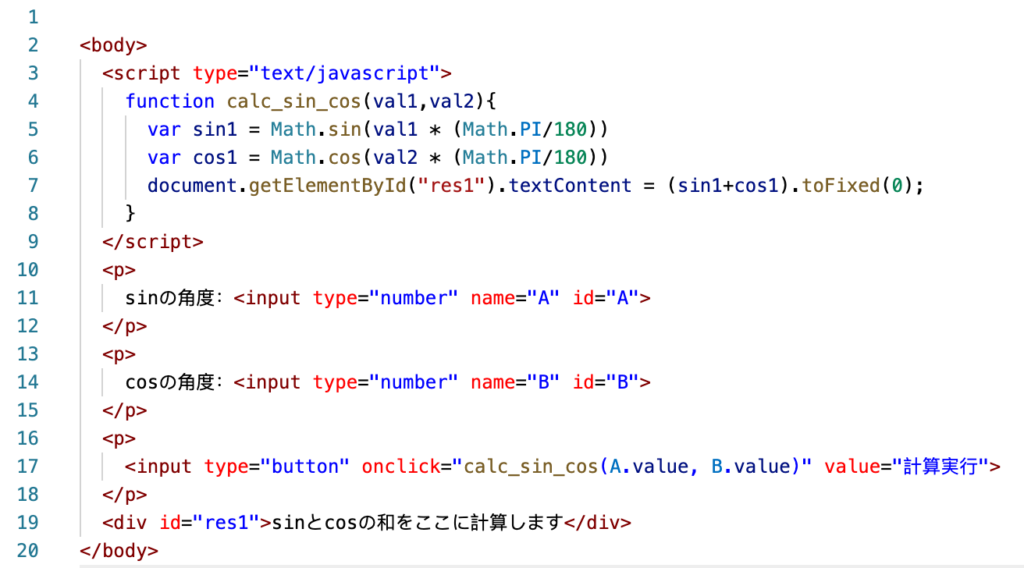

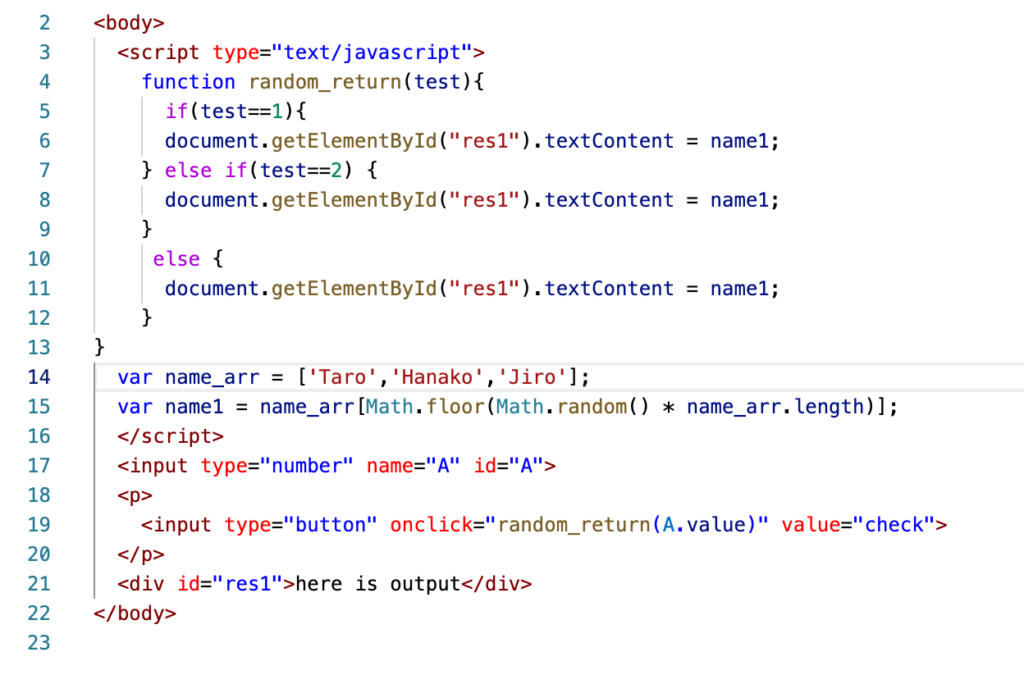

1. python・科学記事のまとめ

D